Pentagon Loại Anthropic Khỏi Hợp Đồng AI 7 Hãng (01/05/2026): Bài Học Chọn AI Vendor Cho Doanh Nghiệp Việt

Ngày 01/05/2026 Pentagon công bố hợp đồng AI mật với 7 nhà cung cấp — Anthropic bị loại vì từ chối điều khoản 'all lawful purposes'. Bài phân tích AUP của 4 hãng AI lớn (Anthropic, OpenAI, Google, Microsoft), vì sao policy stance ngày càng quan trọng, và checklist 7 điểm chọn AI vendor cho doanh nghiệp VN ngành nhạy cảm (banking, healthcare, edu, gov).

- 1Pentagon ký với 7 hãng — Anthropic chấp nhận mất tỷ USD vì AUP›

- 2Sự kiện cụ thể: 7 hãng nào, lý do Anthropic bị loại›

- 3So sánh AUP 4 hãng AI lớn — ai nghiêm ngặt nhất?›

- 4Vì sao Anthropic chấp nhận mất Pentagon tỷ USD?›

- 53 ngành nhạy cảm tại VN cần đọc kỹ AUP nhất›

- 6Checklist 7 điểm chọn AI vendor cho doanh nghiệp VN›

- 7Recap — 3 takeaway từ vụ Anthropic Pentagon›

- 8Câu hỏi thường gặp›

- 9Nguồn tham khảo›

Pentagon ký với 7 hãng — Anthropic chấp nhận mất tỷ USD vì AUP

Pentagon (Bộ Quốc phòng Mỹ) công bố 01/05/2026 ký hợp đồng triển khai AI trên mạng lưới mật với 7 hãng: OpenAI, Google, Microsoft, AWS, Nvidia, SpaceX, Reflection AI. Anthropic bị loại vì từ chối điều khoản 'all lawful purposes'. Giá trị hợp đồng nhiều tỷ USD. Bài phân tích AUP từng vendor + checklist 7 điểm chọn AI provider cho doanh nghiệp VN ngành nhạy cảm.

Đây không phải chỉ là tin AI — đây là case study lớn nhất 2026 về AI policy và vendor selection. Khi một hãng AI hàng đầu (Claude.ai, $30B ARR) sẵn sàng từ chối hợp đồng nhiều tỷ USD vì nguyên tắc, doanh nghiệp khách hàng cần đặt câu hỏi: policy stance của AI vendor có thể ảnh hưởng business của tôi như thế nào trong 24 tháng tới?

Bài viết này phân tích chi tiết: (a) vì sao Anthropic từ chối, (b) so sánh AUP của 4 hãng AI lớn (OpenAI, Anthropic, Google, Microsoft), (c) 3 ngành nhạy cảm tại VN cần đọc kỹ AUP nhất, (d) checklist 7 điểm đánh giá AI vendor trước khi ký hợp đồng dài hạn.

CTO/CIO doanh nghiệp đang chọn AI provider, legal/compliance officer review AUP, founder startup ngành banking/healthcare/edu/gov đang build AI feature, IT manager team scale dùng AI internal. Nếu bạn dùng ChatGPT cá nhân — bài này không bắt buộc đọc.

Liên quan: Cập nhật AI tuần 18/2026 cover sự kiện này ngắn gọn; GPT-5.5 ra mắt phân tích kỹ thuật một trong 7 vendor được chọn.

Sự kiện cụ thể: 7 hãng nào, lý do Anthropic bị loại

Theo CNN Business + Navy Times (01/05/2026), Pentagon ký Master AI Agreement với 7 nhà cung cấp triển khai trên classified networks (mạng lưới mật, JWICS / SIPRNet):

| Hãng | Vai trò trong hợp đồng | Strength |

|---|---|---|

| OpenAI | LLM frontier (GPT-5.5) | Reasoning, agentic |

| Gemini 3.1 Pro + Cloud | Multimodal, Workspace | |

| Microsoft | Azure AI + Copilot | Enterprise integration |

| AWS | Bedrock platform | Multi-model hosting |

| Nvidia | GPU + AI Enterprise stack | Hardware acceleration |

| SpaceX | Starlink + AI ops | Edge connectivity |

| Reflection AI | Frontier model startup | Compliance willingness |

Anthropic từ chối điều khoản cho phép Pentagon dùng Claude cho 'all lawful purposes'. Cụm từ này — theo Anthropic — bao gồm cả 2 lằn ranh đỏ trong AUP từ 2022:

- 1 Domestic mass surveillance: Giám sát hàng loạt công dân trong nước. Anthropic AUP cấm tuyệt đối use case 'theo dõi hành vi người không có lệnh tòa án'.

- 2 Fully autonomous weapons systems: Vũ khí ra quyết định sát thương không có con người trong loop. Anthropic AUP yêu cầu 'human-in-the-loop' bắt buộc cho mọi use case quân sự sát thương.

Anthropic không từ chối hoàn toàn quân sự — họ vẫn bán Claude cho intelligence analysis, threat detection, document review. Chỉ từ chối khi điều khoản 'all lawful' che đậy 2 use case trên.

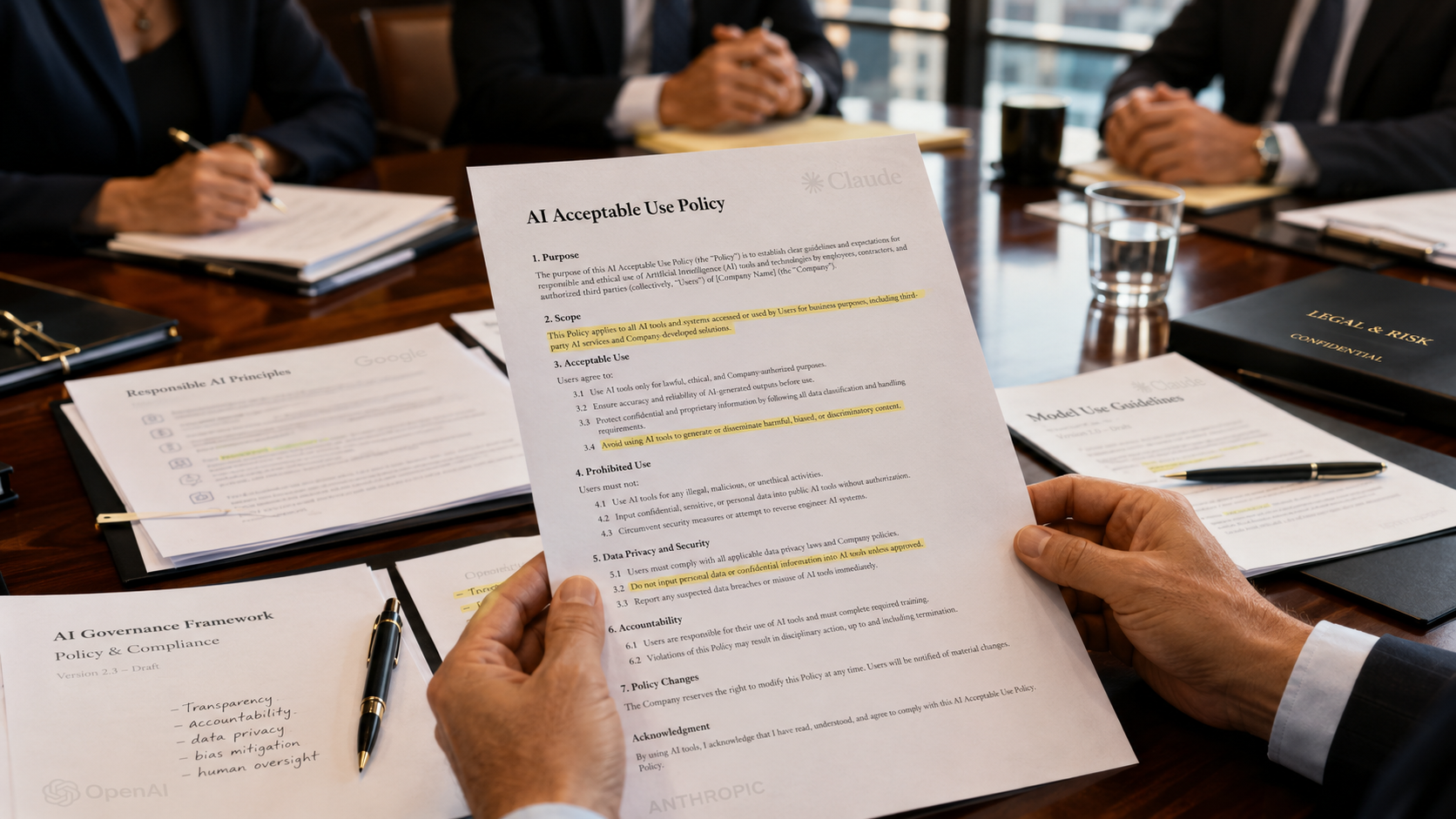

So sánh AUP 4 hãng AI lớn — ai nghiêm ngặt nhất?

Doanh nghiệp khách hàng cần đọc AUP để biết vendor sẽ refuse service cho use case nào. Bảng so sánh dựa trên AUP version đầu tháng 5/2026:

| Use case | Anthropic | OpenAI | Google (Gemini) | Microsoft (Copilot) |

|---|---|---|---|---|

| Mass surveillance | Cấm | Cấm 'unlawful' (mơ hồ) | Cấm | Tuân theo law địa phương |

| Autonomous weapons | Cấm | Cấm | Cấm | Cấm |

| Adult/NSFW content | Cấm | Hạn chế (Plus tier) | Cấm | Cấm |

| Medical advice | Disclaimer bắt buộc | Disclaimer | Disclaimer | Disclaimer |

| Political campaigning | Cấm | Cấm 'persuasion' | Cấm | Hạn chế |

| Gambling content | Cấm | Hạn chế | Tuân law | Cho phép |

| Crypto/financial advice | Disclaimer | Disclaimer | Disclaimer | Cho phép disclaimer |

Phân tích 'cứng → mềm':

- Anthropic (cứng nhất): AUP ngắn, rõ ràng, ít cụm mơ hồ. Predictable nhưng restrictive — không phù hợp gaming/gambling/adult.

- Google (cứng): AUP nghiêm vì rủi ro brand (Search/YouTube/Workspace) — tương tự Anthropic ở use case nhạy cảm.

- OpenAI (trung): AUP có nhiều cụm 'reasonable', 'unlawful' để vendor có quyền chấp nhận case-by-case. Linh hoạt hơn nhưng ít predictable.

- Microsoft Copilot (mềm): Thừa hưởng ToS Azure cho enterprise — linh hoạt nhất, nhưng vẫn cấm autonomous weapons + adult.

Mọi hãng AI lớn (trừ self-host) đều có quyền đổi AUP với 30 ngày notice. Doanh nghiệp ký hợp đồng nên: (1) lưu bản AUP version date ký, (2) review AUP định kỳ 6 tháng, (3) có fallback provider nếu AUP đổi không phù hợp.

Vì sao Anthropic chấp nhận mất Pentagon tỷ USD?

Quyết định Anthropic gây chia rẽ — nội bộ và cộng đồng. Phân tích 3 lý do chiến lược:

1. Brand differentiation: Anthropic xây dựng identity 'safety-first' từ founding (Dario + Daniela Amodei tách OpenAI 2021 vì lo concerns AI safety). Bỏ Pentagon là proof point — ngôn ngữ marketing match hành động. Khách hàng enterprise ngành ngân hàng/healthcare/legal trả premium cho vendor có AUP nghiêm — Anthropic bảo vệ tier khách hàng này.

2. Hiring leverage: Top researcher AI ngày càng quan tâm safety/alignment values. Việc bỏ Pentagon là signal mạnh thu hút talent từ DeepMind, Google Brain, ex-OpenAI. Trong 18 tháng qua Anthropic hire được Sam Bowman, Jan Leike, Yoshua Bengio (advisor) — top tier alignment community.

3. Long-term regulatory hedge: EU AI Act + future US AI regulation có thể bắt buộc 'human-in-the-loop' cho high-risk use case. Anthropic AUP đã align sẵn → không cần refactor sản phẩm khi luật ban hành. OpenAI/Microsoft sẽ cần sửa AUP retroactively.

'Chúng tôi không claim mọi AI company nên có AUP giống Anthropic. Chúng tôi claim AUP của Anthropic phù hợp với điều làm Claude có giá trị. Nếu khách hàng cần linh hoạt mà chúng tôi không có — họ nên chọn vendor khác.'

Hệ quả với khách hàng enterprise: Tin tốt — Anthropic ổn định ($30B ARR đủ runway 5+ năm) và dự đoán được. Tin xấu — nếu use case của bạn đang trong vùng xám AUP, có thể bị cut off đột ngột. Kiểm tra AUP trước khi build production.

3 ngành nhạy cảm tại VN cần đọc kỹ AUP nhất

Doanh nghiệp Việt Nam ở 3 ngành sau cần review AUP kỹ trước khi chọn AI vendor:

1. Banking & FinTech (theo Decree 13/2023 + Circular 64/2024 NHNN)

- Use case rủi ro: AI scoring tín dụng cá nhân (cấm 'unfair discrimination' theo AUP cả 4 hãng), chatbot tư vấn đầu tư (yêu cầu disclaimer), KYC face recognition.

- Nguy cơ AUP: OpenAI có thể từ chối nếu detect 'high-stakes financial decision without human review'. Anthropic cấm tuyệt đối 'AI fully decides loan without human-in-the-loop'.

- Khuyến nghị: Dùng 2 vendor — Anthropic cho fraud detection + summarization (AUP align với compliance VN), OpenAI/Azure cho chatbot khách hàng mass-market.

2. Healthcare & Telemedicine

- Use case rủi ro: Chẩn đoán hỗ trợ AI, dịch hồ sơ bệnh án, automation prescription. Cả 4 vendor đều cấm 'AI making final medical decision'.

- Nguy cơ AUP: Vendor có thể từ chối nếu phát hiện app sai disclaimer hoặc handle PHI (Protected Health Information) sai cách.

- Khuyến nghị: Self-host model nhỏ (Llama 4 8B, DeepSeek V4-Flash) cho task xử lý PHI nội bộ; chỉ gọi API vendor cho task generic (translate, summarize public doc).

3. Edu & Gov-tech

- Use case rủi ro: AI grading học sinh (cấm 'high-stakes evaluation without review'), chatbot luật cho công dân (Anthropic cấm 'unauthorized practice of law').

- Nguy cơ AUP: Microsoft Copilot và Google linh hoạt hơn cho gov-tech nhờ partnership chính phủ Mỹ — phù hợp gov-tech VN hơn Anthropic.

- Khuyến nghị: Microsoft Azure AI cho gov contracts (đã được Bộ TT&TT VN audit tier 1), Anthropic cho task internal IT Bộ.

Xem thêm bài bảo mật tài khoản cá nhân để hiểu compliance basic cho team build AI.

Checklist 7 điểm chọn AI vendor cho doanh nghiệp VN

Trước khi ký hợp đồng AI vendor dài hạn (>12 tháng), audit theo 7 điểm:

- 1 Đọc full AUP version date hôm nay — không đọc summary marketing. Tải PDF lưu local.

- 2 Liệt kê 5 use case production của bạn → match với từng dòng AUP. Vùng xám đánh dấu để hỏi vendor.

- 3 Yêu cầu vendor confirm bằng email cho 5 use case của bạn — biên bản giấy có giá trị legal nếu sau này tranh chấp.

- 4 Kiểm tra change history AUP 12 tháng qua — vendor đổi AUP thường xuyên = rủi ro cao.

- 5 Test fallback provider — setup song song 1 vendor backup trên 10% workload. Nếu AUP đổi, switch trong 1 tuần thay vì 1 tháng.

- 6 Yêu cầu data residency clause — đặc biệt nếu vendor host data ngoài VN (Decree 13/2023 yêu cầu specific cho data nhạy cảm).

- 7 Set review schedule định kỳ 6 tháng — re-read AUP, đánh giá use case mới, update nếu cần.

Doanh nghiệp >50 người không nên dùng chỉ 1 AI vendor. Setup tối thiểu 2 vendor + 1 self-host model nhỏ (Llama 4 8B / DeepSeek V4-Flash) cho data nhạy cảm. Cost tăng ~15-20% nhưng giảm rủi ro vendor lock + compliance shock.

Doanh nghiệp <50 người? Có thể đơn giản hơn: 1 vendor chính + bookmark AUP fallback. Xem SaaS nhỏ làm gọn trang đích để áp dụng nguyên tắc tinh gọn cho team nhỏ.

Recap — 3 takeaway từ vụ Anthropic Pentagon

3 takeaway chính từ vụ Anthropic-Pentagon:

- 1 AI vendor không trung lập về policy — mỗi vendor có values riêng, sẽ refuse hoặc accept use case dựa trên đó. Đọc AUP ngay khi chọn vendor là không thương lượng.

- 2 Vendor lock-in giờ có 2 chiều rủi ro: cost (đã biết) + policy change (chưa được đánh giá đủ). Đa dạng hóa là defensive move thực dụng.

- 3 Hãng AI 'cứng' về AUP có thể là lựa chọn an toàn cho ngành nhạy cảm dài hạn — predictable hơn 'mềm dẻo' nhưng dễ đổi.

- 1 Tải AUP hôm nay của vendor đang dùng (Anthropic/OpenAI/Google/MS) — lưu PDF local.

- 2 Liệt kê 5 use case production → highlight vùng xám.

- 3 Email customer success contact xác nhận 5 use case.

- 4 Setup 1 fallback vendor cho 10% workload (test API + billing).

- 5 Set calendar reminder 6 tháng review AUP next.

Bookmark chuyên mục AI & Công nghệ để theo dõi tin AUP/policy change của các vendor lớn — đăng mỗi tuần.

Câu hỏi thường gặp

Anthropic loại Pentagon có nghĩa là Claude an toàn hơn các vendor khác cho doanh nghiệp VN không?

▾

Doanh nghiệp <20 người có cần đọc full AUP không?

▾

Reflection AI là ai? Có đủ năng lực thay Anthropic trong Pentagon contract không?

▾

Doanh nghiệp VN ngành banking có bắt buộc dùng Anthropic không?

▾

Self-host model open-source (Llama 4, DeepSeek V4) có giải quyết hết rủi ro AUP không?

▾

OpenAI và Microsoft Copilot dùng cùng GPT-5.5 — AUP có giống nhau không?

▾

Nguồn tham khảo chính thức

Lập trình viên độc lập tại Hà Nội. Tốt nghiệp ĐH Bách Khoa Hà Nội năm 2018, đạt giải nhì FPT Software Innovation Hackathon 2017. Đã ship 8 SaaS công cụ miễn phí (PDF, ImgTools, OneGen, SEOTool, KiTuDacBiet…) phục vụ người Việt từ năm 2018, với hơn 80 tool browser-side, không signup, tôn trọng quyền riêng tư.

Sau khi đọc xong, bạn có thể chuyển sang đúng công cụ liên quan để thử ngay trong bối cảnh thực tế.

Đọc thêm tin AI tuần 18/2026